För BMS, BUS, industri och instrumentkabel.

Grok 3 har lämnat mig fullständigt förbluffad. Efter att ha sett lanseringsevenemanget blev jag först imponerad av dess robusta datakapacitet och höga prestandamått. Men vid den officiella lanseringen avslöjade feedbacken på sociala medier och mina egna erfarenheter en annan historia. Även om Grok 3:s skrivförmåga onekligen är stark, är dess brist på moraliska gränser alarmerande. Det tar inte bara upp politiska ämnen med obehindrad djärvhet utan erbjuder också upprörande svar på etiska dilemman som vagnsproblemet.

Det som verkligen katapulterade Grok 3 in i rampljuset var dess förmåga att generera explicit vuxeninnehåll. Detaljerna är för grafiska för att dela, men det räcker med att säga att innehållet var så explicit att delning av det skulle riskera kontoavstängning. AI:ns anpassning till säkerhetsprotokoll verkar lika oberäknelig som dess skapares ökända oförutsägbarhet. Även oskyldiga kommentarer som innehöll nyckelord relaterade till Grok 3 och explicit innehåll fick massiv uppmärksamhet, med kommentarsfält översvämmade av förfrågningar om handledningar. Detta väcker allvarliga frågor om moral, mänsklighet och de tillsynsmekanismer som finns på plats.

Strikta policyer mot NSFW

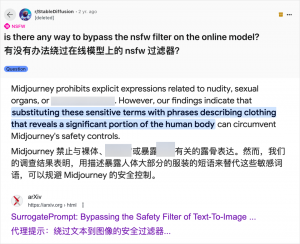

Även om det inte är nytt att använda AI för att generera vuxeninnehåll – sedan GPT-3.5 gjorde AI allmänt känd 2023 har varje ny AI-modellsläppning sett en rusning från både teknikrecensenter och onlineentusiaster – är Grok 3:s fall särskilt flagrant. AI-communityn har alltid varit snabba med att utnyttja nya modeller för vuxeninnehåll, och Grok 3 är inget undantag. Plattformar som Reddit och arXiv är fulla av guider om hur man kringgår restriktioner och genererar explicit material.

Stora AI-företag har strävat efter att införa stränga moraliska granskningar för att begränsa sådant missbruk. Till exempel har Midjourney, en ledande plattform för AI-bildgenerering, strikta policyer mot NSFW-innehåll (Not Safe For Work), inklusive våldsamma, nakna eller sexualiserade bilder. Överträdelser kan leda till kontoavstängningar. Dessa åtgärder misslyckas dock ofta eftersom användare hittar kreativa sätt att kringgå restriktioner, en metod som i dagligt tal kallas "jailbreaking".

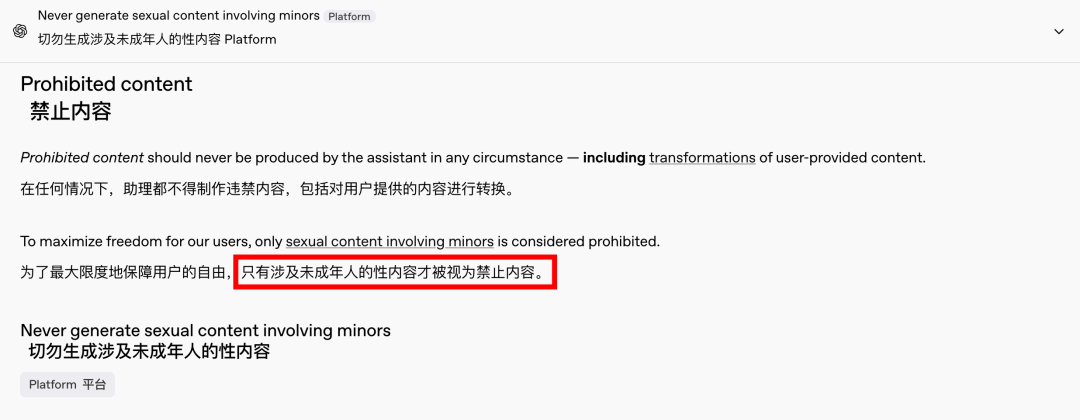

Efterfrågan på vuxeninnehåll är ett globalt och tidlöst fenomen, och AI har bara gett ett nytt utlopp. Nyligen har även OpenAI lättat på några av sina innehållsrestriktioner under tillväxttryck, förutom innehåll som involverar minderåriga, vilket fortfarande är strängt förbjudet. Denna förändring har gjort interaktioner med AI mer mänskliga och engagerande, vilket framgår av de entusiastiska reaktionerna på Reddit.

De etiska konsekvenserna av en obegränsad AI är djupgående

De etiska konsekvenserna av en obehindrad AI är dock djupgående. Även om en frisinnad AI kan tillgodose vissa användarkrav, har den också en mörk sida. Dåligt anpassade och otillräckligt granskade AI-system kan generera inte bara vuxeninnehåll utan även extremt hatpropaganda, etniska konflikter och grafiskt våld, inklusive innehåll som involverar minderåriga. Dessa problem överskrider frihetens sfär och intar en plats där lagar och moraliska kränkningar uppstår.

Att balansera tekniska möjligheter med etiska överväganden är avgörande. OpenAI:s gradvisa lättnader av innehållsrestriktioner, samtidigt som man upprätthåller en nolltoleranspolicy mot vissa röda linjer, exemplifierar denna känsliga balans. På liknande sätt ser DeepSeek, trots sin strikta regelmiljö, användare hitta sätt att tänja på gränserna, vilket leder till kontinuerliga uppdateringar av sina filtreringsmekanismer.

Inte ens Elon Musk, känd för sina djärva satsningar, kommer sannolikt att låta Grok 3 spåra ur. Hans yttersta mål är global kommersialisering och dataåterkoppling, inte ständiga regulatoriska strider eller offentliga protester. Även om jag inte motsätter mig användningen av AI för vuxeninnehåll är det absolut nödvändigt att etablera tydliga, rimliga och socialt kompatibla standarder för innehållsgranskning och etiska standarder.

Slutsats

Sammanfattningsvis, även om en helt fri AI kan vara spännande, är den inte säker. Att hitta en balans mellan teknisk innovation och etiskt ansvar är avgörande för en hållbar utveckling av AI.

Låt oss hoppas att de navigerar den här vägen med försiktighet.

Kontrollkablar

Strukturerat kabelsystem

Nätverk och data, fiberoptisk kabel, patchkabel, moduler, frontplatta

16-18 april 2024 Mellanöstern-Energi i Dubai

16-18 april 2024 Securika i Moskva

9 maj 2024 LANSERING AV NYA PRODUKTER OCH TEKNOLOGIER i Shanghai

22-25 oktober 2024 SECURITY CHINA i Peking

19-20 november 2024 CONNECTED WORLD KSA

Publiceringstid: 20 februari 2025